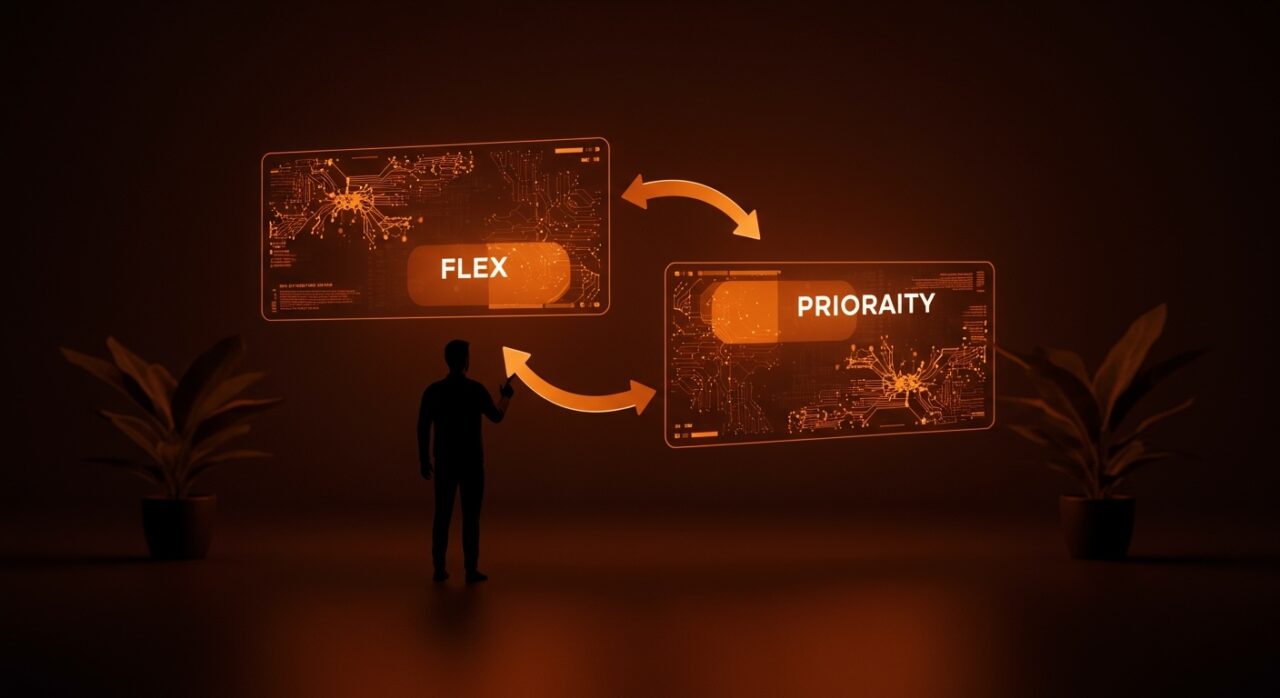

¿Qué son Flex y Priority en la API Gemini de Google?

Google acaba de presentar dos nuevos modos de inferencia para su API Gemini: Flex y Priority, que responden a las necesidades críticas de founders y desarrolladores de startups tecnológicas en LATAM: optimizar costos y mejorar rendimiento en inteligencia artificial. Con estos modos, es posible elegir entre procesar tareas de IA de forma más barata (Flex) o priorizarlas para máxima velocidad (Priority), siempre usando los modelos Gemini 2.5 Flash, Pro o Gemma 4.

Modo Flex: Ahorro máximo para cargas no urgentes

El modo Flex permite ejecutar inferencias diferidas con hasta un 75% de descuento respecto al precio estándar. Está pensado para cargas de trabajo que pueden esperar: procesamiento por lotes, generación masiva de datos, o tareas nocturnas donde la latencia es secundaria. Esta modalidad hace que la IA generativa sea accesible para startups en fase de escalamiento, particularmente cuando cada dólar de AWS, GCP o Azure cuenta.

Modo Priority: Respuesta en tiempo real, pagando más

Para casos de producción donde la latencia es un factor crítico (por ejemplo, asistentes virtuales o features dentro de productos con muchos usuarios concurrentes), Priority ofrece la menor latencia posible, acelerando la inferencia hasta 2x más rápido a cambio de pagar el doble del precio estándar. Es la opción para quienes necesitan experiencias en tiempo real y no pueden sacrificar velocidad por costo.

👥 ¿Quieres ir más allá de la noticia?

En nuestra comunidad discutimos las tendencias, compartimos oportunidades y nos ayudamos entre emprendedores. Sin humo, solo acción.

👥 Unirme a la comunidadVentajas estratégicas para founders

La propuesta de Google democratiza el acceso a diferentes perfiles de inferencia, usando el mismo modelo base. Esto flexibiliza tanto la experimentación como la operación a escala: puedes designar ciertas tareas como batch económicas (Flex) y las que requieran inmediatez como Priority, todo sin cambiar de modelo ni ajustar tu stack. Además, Google sigue la línea de OpenAI, lo que muestra una tendencia de mercado hacia un pricing más granular y flexible para IA.

¿Cómo comenzar a usar estos modos?

Ambos modos ya están disponibles dentro de la API Gemini. Se pueden configurar al momento de realizar peticiones a la API, especificando el modo según la necesidad de tu flujo de trabajo.

Conclusión

Google responde a una necesidad recurrente en el ecosistema: que la optimización de costos no sacrifique acceso a modelos de IA avanzados. Los modos Flex y Priority permiten a founders y equipos técnicos maximizar el retorno de inversión y sofisticar sus productos según las demandas de sus usuarios y sus propios presupuestos.

Descubre cómo otros founders implementan estas soluciones para IA y optimización de costos en nuestra comunidad.

Fuentes

- https://wwwhatsnew.com/2026/04/04/google-flex-priority-api-gemini-descuento-75-inferencia/ (fuente original)

- https://developers.googleblog.com/2026/04/introducing-flex-and-priority-inference-modes-for-gemini-api.html (fuente adicional)

- https://blog.google/technology/ai/new-gemini-api-flex-priority-inference/ (fuente adicional)

- https://cloud.google.com/blog/products/ai-machine-learning/google-gemini-api-flex-priority-inference-modes (fuente adicional)

👥 ¿Quieres ir más allá de la noticia?

En nuestra comunidad discutimos las tendencias, compartimos oportunidades y nos ayudamos entre emprendedores. Sin humo, solo acción.

👥 Unirme a la comunidad