El bloqueo de chips que no salió como esperaban

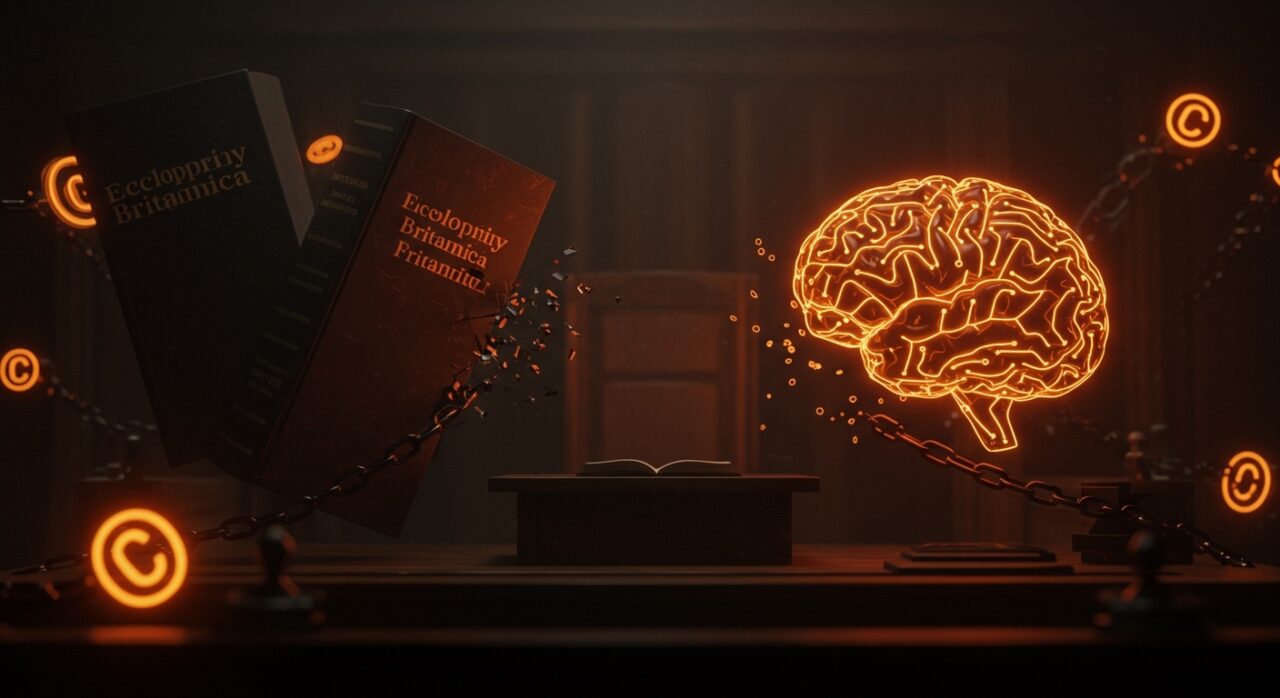

Desde 2022, Estados Unidos ha construido una muralla tecnológica sin precedentes: prohibió la exportación de sus chips de inteligencia artificial más potentes —los Nvidia A100, H100, H800 y posteriormente el H20— hacia China, con el objetivo explícito de frenar el avance de la IA china y preservar la supremacía tecnológica occidental. La apuesta parecía razonable sobre el papel: sin el hardware correcto, no hay grandes modelos de lenguaje.

Pero la historia rara vez sigue el guion que escriben los estrategas de Washington. El resultado de estas restricciones no ha sido una China rezagada en IA, sino una industria que aprendió a hacer más con menos, y que hoy ofrece tokens de inferencia más baratos que cualquier competidor occidental. Para los founders tech, esto cambia el cálculo de costos de construir productos con IA de forma radical.

Cómo China convirtió la escasez en ventaja competitiva

La lógica del bloqueo partía de una premisa válida: entrenar modelos masivos de IA requiere cientos de miles de GPUs de última generación. Sin acceso a ellas, la brecha con OpenAI, Google o Anthropic sería insalvable. Lo que no calcularon fue la capacidad de adaptación del ecosistema chino de IA.

👥 ¿Quieres ir más allá de la noticia?

En nuestra comunidad discutimos las tendencias, compartimos oportunidades y nos ayudamos entre emprendedores. Sin humo, solo acción.

👥 Unirme a la comunidadEn lugar de competir en la carrera de los modelos más grandes y costosos, empresas chinas como DeepSeek —filial del hedge fund High-Flyer— apostaron por una ruta distinta: eficiencia radical en arquitectura de software. El resultado es sorprendente. DeepSeek entrenó su modelo V3 por apenas 5,6 millones de dólares usando 2,788 millones de horas de GPU H800 sobre 14,8 billones de tokens. En contraste, se estima que OpenAI invirtió más de 100 millones de dólares en entrenar GPT-4.

La clave técnica está en la arquitectura Mixture of Experts (MoE): en lugar de activar todos los parámetros del modelo para cada token procesado —como hacen los modelos densos tradicionales—, MoE activa solo los ‘expertos’ necesarios para cada tarea. DeepSeek V4 requiere aproximadamente 250 GFLOPs por token frente a los 2.448 GFLOPs de modelos comparables occidentales. Eso es una eficiencia computacional 10 veces superior, lograda sin acceso a las GPUs más avanzadas del mundo.

La brecha de precios por token: datos concretos para founders

Para un founder que construye un producto SaaS, una app o un agente de IA, el costo por token no es un detalle técnico: es la diferencia entre márgenes positivos y un unit economics que no cuadra. Aquí los números hablan por sí solos:

| Modelo | Entrada /1M tokens | Salida /1M tokens |

|---|---|---|

| DeepSeek V3.1 | $0,15 | ~$0,28 |

| DeepSeek R1 | $0,70 | $2,19 |

| GPT-4o (OpenAI) | $2,50 | $10,00 |

| GPT-4 (original) | $30,00 | $60,00 |

La comparación es contundente: DeepSeek R1 cuesta un 97% menos que GPT-4 en tokens de entrada, mientras que en benchmarks de razonamiento matemático y codificación compite directamente con los modelos tope de gama de OpenAI. Para una startup que procesa 100 millones de tokens diarios, eso supone pagar aproximadamente 1,95 millones de dólares anuales con GPT-4o frente a solo 92.400 dólares con DeepSeek V3. La diferencia es un runway adicional de meses o incluso la viabilidad completa del negocio.

Token export: la nueva arma económica china en IA

La estrategia que está emergiendo tiene un nombre cada vez más usado en los círculos de política tecnológica: token export. La lógica es elegante y efectiva. Si China no puede exportar hardware de IA por las restricciones de EEUU, puede exportar algo igualmente valioso: la inferencia misma como servicio. Los tokens —la unidad básica de consumo de IA— se procesan en servidores chinos con energía más barata, hardware nacional como las GPU Huawei Ascend, y arquitecturas de software optimizadas, y luego se sirven al mundo a precios que los proveedores occidentales no pueden igualar sin destruir sus márgenes.

Esta táctica esquiva de manera brillante la intención del bloqueo tecnológico. EEUU puede controlar qué chips entran a China, pero no puede controlar —al menos no fácilmente— qué servicios digitales salen de ella. El resultado es que startups en LATAM, Europa, Africa y Asia Pacífico acceden hoy a capacidades de IA de nivel GPT-4 a una fracción del costo, con servidores en territorio chino.

Lo que DeepSeek no es el único: el ecosistema chino de IA eficiente

Si bien DeepSeek se ha convertido en el emblema de esta revolución de eficiencia, no actúa solo. Alibaba con su familia de modelos Qwen también compite agresivamente en el segmento de bajo costo por token, con modelos open source disponibles para deployment local o vía API. La estrategia de Alibaba apunta a convertir Qwen en el modelo de referencia para desarrolladores que priorizan control de costos sobre cualquier otra consideración.

Este ecosistema chino de IA —con DeepSeek, Qwen, Baidu ERNIE y otros— forma un frente unificado que presiona los precios globales hacia abajo y obliga a OpenAI, Anthropic y Google a revisar sus estructuras de pricing. No es casualidad que en 2026 el precio de GPT-4o sea una fracción de lo que era hace dos años: la competencia china está disciplinando el mercado.

Los riesgos reales que todo founder debe ponderar

La ecuación de costos parece obvia a favor de los modelos chinos, pero hay variables de riesgo que un founder responsable no puede ignorar:

Soberanía de datos y cumplimiento regulatorio

Cuando procesas datos de usuarios a través de la API de DeepSeek o cualquier proveedor chino, esos datos transitan y se procesan en infraestructura bajo jurisdicción china. Para startups que operan en la Unión Europea bajo GDPR, o en sectores regulados como fintech, salud o defensa, esto puede ser directamente un bloqueante legal. La regulación está evolucionando rápidamente y lo que hoy es una zona gris mañana puede ser una multa o la pérdida de contratos enterprise.

Riesgo de continuidad del servicio

La tensión geopolítica entre EEUU y China no va a ceder pronto. Una escalada en las restricciones tecnológicas —o una respuesta de Pekín— podría cortar el acceso a estos servicios de un día para otro. Construir tu arquitectura de producto con dependencia crítica en un proveedor geopolíticamente vulnerable es una deuda técnica y de negocio que hay que gestionar conscientemente.

Latencia y disponibilidad

Para startups en LATAM, la latencia de conectarse a servidores en China puede ser un problema real en casos de uso donde la velocidad de respuesta es crítica. Esta variable técnica, combinada con los riesgos anteriores, hace que la estrategia óptima para muchos founders sea usar modelos chinos para cargas de trabajo no sensibles y batch processing, mientras mantienen proveedores occidentales para flujos de datos críticos.

Implicaciones para el ecosistema startup LATAM

Para los founders de LATAM que construyen con IA, este nuevo panorama crea oportunidades concretas. La caída de precios por token —impulsada tanto por la competencia china como por la respuesta de los proveedores occidentales— democratiza el acceso a modelos de lenguaje avanzados. Startups que antes no podían costear la inferencia a escala ahora pueden construir productos que eran inviables económicamente hace 18 meses.

La estrategia inteligente pasa por mantener una arquitectura multi-proveedor: aprovechar los precios de DeepSeek para tareas donde el costo es el factor dominante, manteniendo OpenAI, Anthropic o Google para casos de uso donde la soberanía de datos, la latencia o el compliance son críticos. Esta diversificación también protege contra el riesgo de dependencia de un único proveedor en un mercado que cambia a velocidad vertiginosa.

El bloqueo de chips que EEUU diseñó para frenar la IA china terminó acelerando la innovación en eficiencia de software, reduciendo los costos de inferencia para toda la industria, y creando una nueva dinámica de competencia global. En tecnología, las restricciones rara vez funcionan como se planea: a menudo simplemente redirigen la energía hacia soluciones más ingeniosas.

Conclusión

La guerra tecnológica entre EEUU y China está redibujando el mercado global de IA de formas que nadie anticipó completamente. El bloqueo de chips Nvidia no detuvo a China: la obligó a innovar en eficiencia, y hoy esa innovación se traduce en tokens de inferencia entre 10x y 200x más baratos que los modelos occidentales de referencia. Para los founders tech, esto es una señal clara: el costo de construir con IA se va a seguir comprimiendo, los modelos open source de calidad van a seguir proliferando, y la arquitectura multi-proveedor no es un lujo sino una necesidad estratégica. Quien entienda estas fuerzas hoy tendrá una ventaja competitiva real mañana.

Profundiza estos temas con nuestra comunidad de founders que ya están implementando IA en sus startups.

Fuentes

- https://www.xataka.com/robotica-e-ia/eeuu-bloqueo-sus-chips-avanzados-a-china-para-frenar-su-ia-resultado-china-fabrica-tokens-baratos-que-nadie (fuente original)

- https://www.forbesargentina.com/negocios/estados-unidos-acelero-restricciones-exportacion-chips-ia-china-n42955 (restricciones exportacion chips)

- https://www.xtb.com/es/analisis-de-mercado/las-acciones-de-nvidia-caen-debido-a-las-restricciones-de-comercio-con-china (impacto en Nvidia)

- https://mundoglobal.org/china-prohibe-la-compra-de-chips-de-nvidia-pero-de-quien-es-la-culpa (respuesta regulatoria China)

- https://blog.donweb.com/exportacion-chips-ia-nvidia-regulacion-eeuu (nuevas reglas de exportacion EEUU 2026)

- https://pricepertoken.com/compare/deepseek-deepseek-r1-vs-openai-gpt-4 (precios DeepSeek R1 vs GPT-4)

- https://docsbot.ai/models/compare/gpt-4o/deepseek-v3 (comparativa GPT-4o vs DeepSeek V3)

- https://wavespeed.ai/blog/posts/deepseek-v4-cost-per-million-tokens (costo entrenamiento DeepSeek V4)

- https://www.tldl.io/resources/llm-api-pricing-2026 (precios API LLMs 2026)

- https://llm-stats.com/models/compare/deepseek-r1-vs-gpt-4-0613 (benchmarks y precios DeepSeek R1 vs GPT-4)